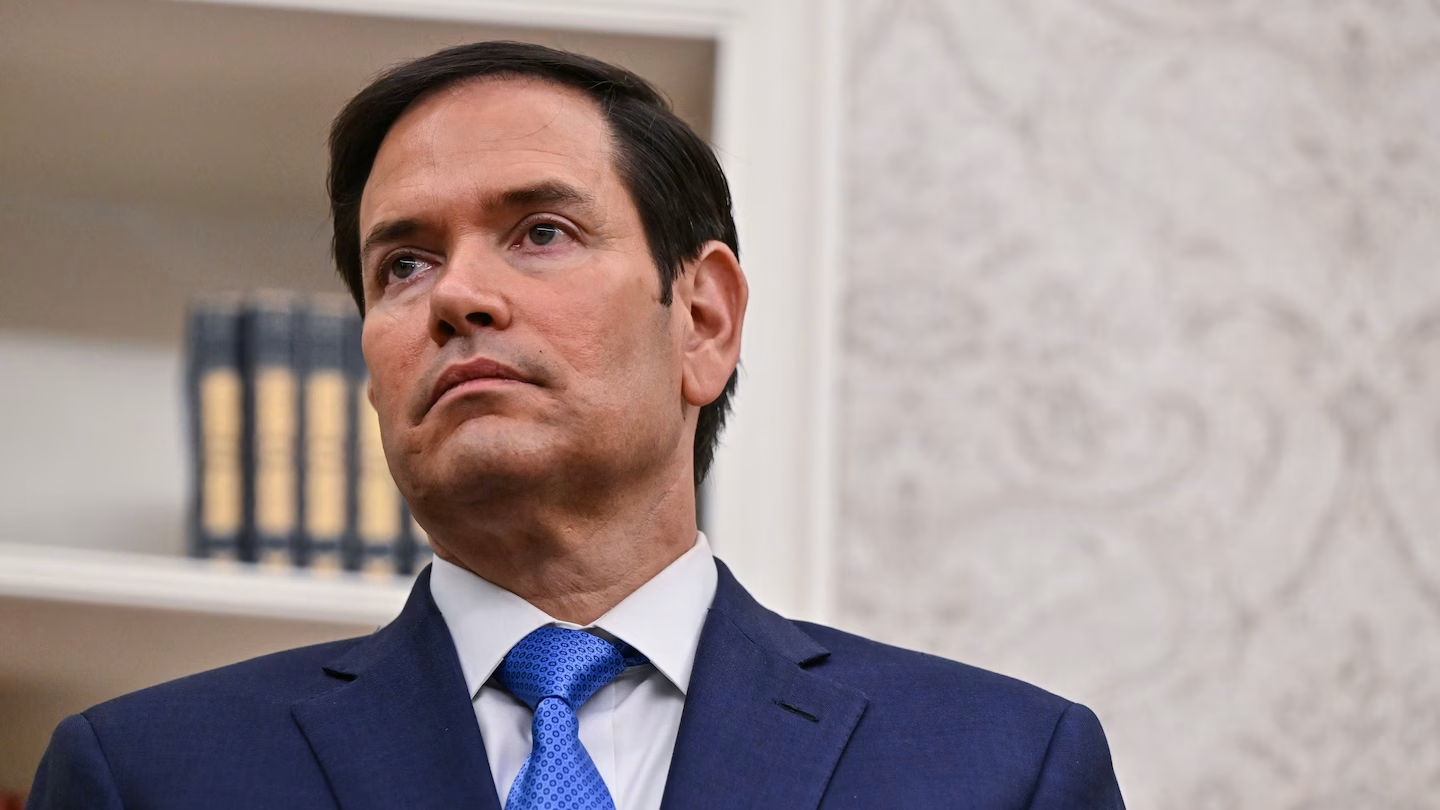

C’est un incident qui illustre les nouvelles vulnérabilités numériques au sommet du pouvoir. Selon un câble diplomatique obtenu par le Washington Post, un individu inconnu s’est fait passer pour Marco Rubio, actuel secrétaire d’État des États-Unis, en utilisant une voix générée par intelligence artificielle. L’opération a visé au moins cinq responsables de haut niveau, dont trois ministres des Affaires étrangères, un gouverneur américain et un membre du Congrès, en combinant appels vocaux et messages écrits imitant parfaitement le style du diplomate.

L’attaque a débuté à la mi-juin via l’application chiffrée Signal, utilisée abondamment par l’administration Trump. L’usurpateur y a créé un compte au nom affiché trompeur de “Marco.Rubio@state.gov” (non associé à une adresse réelle) et a envoyé des messages ainsi que des messages vocaux à ses cibles. Dans certains cas, le message proposait de poursuivre la discussion sur Signal, renforçant l’apparence de légitimité. D’autres tentatives de fraude ont également été signalées via des courriels se faisant passer pour des employés du Département d’État.

L’affaire survient dans un contexte de prolifération de ce type d’attaques. En mai, la cheffe de cabinet de la Maison-Blanche, Susie Wiles, avait vu son téléphone compromis. Un imposteur se faisant passer pour elle avait contacté des sénateurs, gouverneurs et chefs d’entreprise, déclenchant une enquête du FBI. Le président Trump avait minimisé l’incident, estimant que Wiles pouvait « gérer ça », mais la vulnérabilité reste préoccupante.

Pour les experts, ces attaques ne requièrent pas une sophistication extrême. Selon Hany Farid, spécialiste en criminalistique numérique à l’Université de Californie à Berkeley, une vingtaine de secondes d’audio public suffit pour entraîner une voix de synthèse convaincante. Les plateformes grand public permettent ensuite de générer des messages vocaux en quelques clics. « Laisser un message vocal est redoutablement efficace : il n’y a pas d’interaction, donc moins de chances de démasquer l’arnaque », note-t-il.

Le Département d’État américain dit prendre l’affaire « très au sérieux » et a appelé son personnel à signaler tout incident au Bureau de la sécurité diplomatique. Le FBI, de son côté, a déjà alerté en mai contre une campagne “malveillante et continue” ciblant des responsables gouvernementaux à l’aide de textes et de voix générés par IA, dans le but probable d’obtenir des informations sensibles ou de l’argent.

Ce type de manipulation ne se limite pas aux États-Unis. En juin, l’Ukraine a accusé les services de renseignement russes d’avoir imité ses propres agents pour recruter des civils. Le même mois, les autorités canadiennes ont averti de tentatives semblables visant à installer des maliciels ou à escroquer des fonds, toujours en exploitant des voix artificielles de hauts responsables.

Avec l’essor des outils de clonage vocal accessibles au grand public, les experts redoutent que les attaques par imitation ne deviennent monnaie courante dans la sphère diplomatique et politique. Et face à ce risque émergent, les lignes directrices sur l’usage des messageries chiffrées comme Signal par les fonctionnaires sont de plus en plus remises en question.

L’ampleur des dégâts dans l’affaire Rubio n’est pas encore connue. Le Département d’État n’a pas précisé si des informations ont été compromises, ni si les cibles ont répondu à l’usurpateur. Mais une chose est claire : la voix seule ne peut plus suffire à authentifier un interlocuteur.

Source : Washington Post

+++

Tous les jours de la semaine, du lundi au vendredi, Bruno Guglielminetti vous propose un regard sur l’essentiel de l’actualité numérique avec 120 secondes de tech.

En savoir plus sur Mon Carnet

Subscribe to get the latest posts sent to your email.